语音技术在金融AI中的应用与优化

关键词:语音技术、金融AI、应用场景、算法优化、技术挑战

摘要:本文围绕语音技术在金融AI中的应用与优化展开深入探讨。首先介绍了语音技术与金融AI结合的背景和意义,阐述了相关核心概念及联系。接着详细讲解了语音技术的核心算法原理,并给出Python代码示例。通过数学模型和公式进一步剖析其内在机制。在项目实战部分,提供了开发环境搭建步骤、源代码实现及解读。分析了语音技术在金融领域的实际应用场景,推荐了相关的学习资源、开发工具和论文著作。最后总结了未来发展趋势与挑战,解答了常见问题并提供了扩展阅读和参考资料,旨在为语音技术在金融AI中的进一步应用和发展提供全面的技术指导。

1. 背景介绍

1.1 目的和范围

随着人工智能技术的飞速发展,语音技术作为其中的重要分支,在各个领域得到了广泛应用。金融行业作为经济的核心领域,对智能化服务的需求日益增长。本文旨在探讨语音技术在金融AI中的具体应用场景,分析其面临的挑战,并提出相应的优化策略。范围涵盖了语音识别、语音合成、语音交互等主要语音技术在金融客服、风险评估、投资决策等金融业务环节的应用。

1.2 预期读者

本文预期读者包括金融科技领域的从业者,如金融机构的技术研发人员、产品经理;人工智能领域的研究者,特别是专注于语音技术的学者;对金融AI和语音技术感兴趣的学生和爱好者。

1.3 文档结构概述

本文首先介绍语音技术与金融AI相关的背景知识,包括目的、读者群体和文档结构。接着阐述核心概念及其联系,给出原理和架构示意图。然后详细讲解核心算法原理和操作步骤,通过Python代码进行说明。之后介绍数学模型和公式,并举例说明。在项目实战部分,介绍开发环境搭建、源代码实现和代码解读。分析实际应用场景,推荐相关工具和资源。最后总结未来发展趋势与挑战,解答常见问题并提供扩展阅读和参考资料。

1.4 术语表

1.4.1 核心术语定义

语音技术:是一门涉及声学、语音学、信号处理、模式识别等多学科的综合性技术,主要包括语音识别(将语音信号转换为文本)、语音合成(将文本转换为语音)和语音交互(人与机器通过语音进行双向交流)。金融AI:指将人工智能技术应用于金融领域,通过机器学习、深度学习等算法,实现金融业务的自动化、智能化,如风险评估、投资决策、客户服务等。语音识别准确率:指语音识别系统正确识别的语音内容占总语音内容的比例,是衡量语音识别系统性能的重要指标。语音合成自然度:指语音合成系统生成的语音与人类自然语音的相似程度,包括语调、语速、音色等方面。

1.4.2 相关概念解释

深度学习:是一种基于人工神经网络的机器学习方法,通过构建多层神经网络,自动从大量数据中学习特征和模式,在语音技术和金融AI中都有广泛应用。自然语言处理:是研究人与计算机之间用自然语言进行有效通信的各种理论和方法,在语音交互中,自然语言处理技术用于理解用户的语音指令并生成合适的回复。金融知识图谱:是一种将金融领域的实体(如企业、产品、市场等)和关系(如投资关系、借贷关系等)以图的形式表示的知识库,可用于金融风险评估、投资决策等。

1.4.3 缩略词列表

ASR:Automatic Speech Recognition,自动语音识别TTS:Text-to-Speech,文本转语音NLP:Natural Language Processing,自然语言处理DNN:Deep Neural Network,深度神经网络RNN:Recurrent Neural Network,循环神经网络LSTM:Long Short-Term Memory,长短期记忆网络

2. 核心概念与联系

核心概念原理

语音识别原理

语音识别的基本原理是将语音信号转换为文本信息。其主要步骤包括:

语音信号预处理:对采集到的语音信号进行降噪、滤波等处理,以提高信号质量。特征提取:从预处理后的语音信号中提取特征参数,如梅尔频率倒谱系数(MFCC)。声学模型训练:使用大量的语音数据训练声学模型,常用的声学模型有隐马尔可夫模型(HMM)和深度神经网络(DNN)。语言模型训练:语言模型用于处理语音识别中的语义信息,常用的语言模型有统计语言模型和基于深度学习的语言模型。解码:根据声学模型和语言模型,将提取的特征参数转换为文本信息。

语音合成原理

语音合成的基本原理是将文本信息转换为语音信号。其主要步骤包括:

文本分析:对输入的文本进行语法、语义分析,确定语音的语调、语速等参数。语音合成模型训练:使用大量的语音数据训练语音合成模型,常用的语音合成模型有基于统计参数的合成模型和基于深度学习的端到端合成模型。语音生成:根据文本分析结果和语音合成模型,生成语音信号。

金融AI原理

金融AI主要基于机器学习和深度学习算法,对金融数据进行分析和挖掘,以实现金融业务的自动化和智能化。其主要步骤包括:

数据收集:收集金融领域的各种数据,如市场行情、客户信息、交易记录等。数据预处理:对收集到的数据进行清洗、归一化等处理,以提高数据质量。特征工程:从预处理后的数据中提取特征,如财务指标、市场趋势等。模型训练:使用机器学习或深度学习算法对特征数据进行训练,得到预测模型或分类模型。模型评估和优化:使用测试数据对训练好的模型进行评估,根据评估结果对模型进行优化。

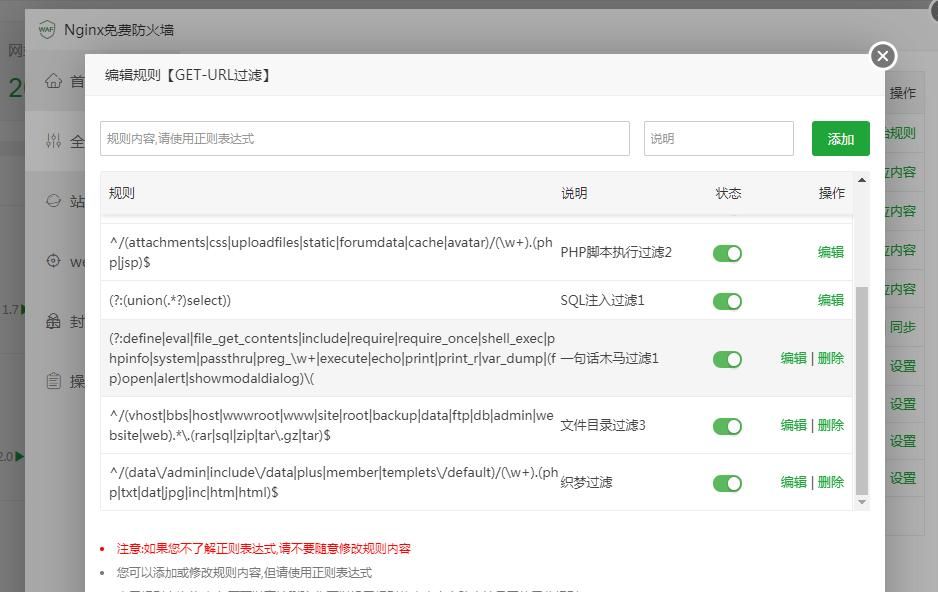

架构示意图

核心概念联系

语音技术与金融AI相互融合,共同推动金融行业的智能化发展。语音识别技术可以将客户的语音指令转换为文本信息,为金融AI系统提供输入;语音合成技术可以将金融AI系统的处理结果转换为语音反馈给客户,实现自然的人机交互。金融AI技术可以对语音识别得到的文本信息进行分析和处理,提供金融决策支持,同时也可以为语音合成提供更加准确的文本内容。

3. 核心算法原理 & 具体操作步骤

语音识别算法原理及Python实现

隐马尔可夫模型(HMM)原理

隐马尔可夫模型是一种统计模型,用于描述一个含有隐含未知参数的马尔可夫过程。在语音识别中,HMM用于描述语音信号的声学特征序列。HMM由三个部分组成:状态转移概率矩阵、观测概率矩阵和初始状态概率向量。

Python代码示例

import numpy as np

# 定义HMM模型参数

states = ('Healthy', 'Fever')

observations = ('normal', 'cold', 'dizzy')

start_probability = {'Healthy': 0.6, 'Fever': 0.4}

transition_probability = {

'Healthy': {'Healthy': 0.7, 'Fever': 0.3},

'Fever': {'Healthy': 0.4, 'Fever': 0.6}

}

emission_probability = {

'Healthy': {'normal': 0.5, 'cold': 0.4, 'dizzy': 0.1},

'Fever': {'normal': 0.1, 'cold': 0.3, 'dizzy': 0.6}

}

def viterbi(obs, states, start_p, trans_p, emit_p):

V = [{}]

path = {}

# 初始化第一步

for y in states:

V[0][y] = start_p[y] * emit_p[y][obs[0]]

path[y] = [y]

# 递推计算后续步骤

for t in range(1, len(obs)):

V.append({})

newpath = {}

for y in states:

(prob, state) = max((V[t - 1][y0] * trans_p[y0][y] * emit_p[y][obs[t]], y0) for y0 in states)

V[t][y] = prob

newpath[y] = path[state] + [y]

path = newpath

# 找到概率最大的路径

(prob, state) = max((V[len(obs) - 1][y], y) for y in states)

return (prob, path[state])

# 测试

obs = ('normal', 'cold', 'dizzy')

prob, path = viterbi(obs, states, start_probability, transition_probability, emission_probability)

print("Most likely state sequence:", path)

print("Probability:", prob)

语音合成算法原理及Python实现

基于深度学习的端到端语音合成原理

基于深度学习的端到端语音合成模型直接将输入的文本转换为语音信号,避免了传统语音合成方法中复杂的中间步骤。常用的端到端语音合成模型有Tacotron和WaveNet。

Python代码示例(使用Tacotron 2和WaveGlow)

import torch

from scipy.io.wavfile import write

from tacotron2.text import text_to_sequence

from tacotron2.model import Tacotron2

from waveglow.glow import WaveGlow

# 加载模型

tacotron2 = Tacotron2()

tacotron2.load_state_dict(torch.load('tacotron2.pth')['state_dict'])

tacotron2.eval()

waveglow = WaveGlow()

waveglow.load_state_dict(torch.load('waveglow.pth')['state_dict'])

waveglow.eval()

# 输入文本

text = "Hello, welcome to the financial world."

sequence = np.array(text_to_sequence(text, ['english_cleaners']))[None, :]

sequence = torch.autograd.Variable(torch.from_numpy(sequence)).long()

# 生成语音

with torch.no_grad():

mel_outputs, mel_outputs_postnet, _, alignments = tacotron2.inference(sequence)

audio = waveglow.infer(mel_outputs_postnet)

audio_numpy = audio[0].data.cpu().numpy()

rate = 22050

write("output.wav", rate, audio_numpy)

金融AI算法原理及Python实现

逻辑回归算法原理

逻辑回归是一种常用的分类算法,用于处理二分类问题。在金融领域,逻辑回归可以用于信用风险评估,预测客户是否会违约。

Python代码示例

import numpy as np

from sklearn.linear_model import LogisticRegression

from sklearn.model_selection import train_test_split

from sklearn.metrics import accuracy_score

# 生成示例数据

X = np.random.rand(100, 5)

y = np.random.randint(0, 2, 100)

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 训练逻辑回归模型

model = LogisticRegression()

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print("Accuracy:", accuracy)

4. 数学模型和公式 & 详细讲解 & 举例说明

语音识别数学模型

隐马尔可夫模型(HMM)数学公式

HMM的数学模型可以用一个五元组 λ=(S,O,A,B,π)lambda=(S, O, A, B, pi)λ=(S,O,A,B,π) 表示,其中:

S={s1,s2,⋯ ,sN}S = {s_1, s_2, cdots, s_N}S={s1,s2,⋯,sN} 是状态集合,NNN 是状态的数量。O={o1,o2,⋯ ,oM}O = {o_1, o_2, cdots, o_M}O={o1,o2,⋯,oM} 是观测符号集合,MMM 是观测符号的数量。A=[aij]N×NA = [a_{ij}]_{N imes N}A=[aij]N×N 是状态转移概率矩阵,其中 aij=P(qt+1=sj∣qt=si)a_{ij} = P(q_{t+1}=s_j|q_t=s_i)aij=P(qt+1=sj∣qt=si) 表示在时刻 ttt 处于状态 sis_isi 的条件下,在时刻 t+1t+1t+1 转移到状态 sjs_jsj 的概率。B=[bj(k)]N×MB = [b_j(k)]_{N imes M}B=[bj(k)]N×M 是观测概率矩阵,其中 bj(k)=P(ot=vk∣qt=sj)b_j(k) = P(o_t=v_k|q_t=s_j)bj(k)=P(ot=vk∣qt=sj) 表示在时刻 ttt 处于状态 sjs_jsj 的条件下,观测到符号 vkv_kvk 的概率。π=(π1,π2,⋯ ,πN)pi = (pi_1, pi_2, cdots, pi_N)π=(π1,π2,⋯,πN) 是初始状态概率向量,其中 πi=P(q1=si)pi_i = P(q_1=s_i)πi=P(q1=si) 表示在时刻 t=1t = 1t=1 处于状态 sis_isi 的概率。

维特比算法数学公式

维特比算法用于寻找HMM中最可能的状态序列。设 δt(i)delta_t(i)δt(i) 表示在时刻 ttt 处于状态 sis_isi 的所有可能路径中概率最大的路径的概率,则有:

初始化:δ1(i)=πibi(o1), 1≤i≤Ndelta_1(i)=pi_i b_i(o_1), 1 leq i leq Nδ1(i)=πibi(o1), 1≤i≤N递推:δt+1(j)=max1≤i≤N[δt(i)aij]bj(ot+1), 1≤j≤N,1≤t≤T−1delta_{t+1}(j)=max_{1 leq i leq N}[delta_t(i) a_{ij}] b_j(o_{t+1}), 1 leq j leq N, 1 leq t leq T-1δt+1(j)=max1≤i≤N[δt(i)aij]bj(ot+1), 1≤j≤N,1≤t≤T−1终止:P∗=max1≤i≤N[δT(i)]P^*=max_{1 leq i leq N}[delta_T(i)]P∗=max1≤i≤N[δT(i)]

语音合成数学模型

Tacotron 2数学模型

Tacotron 2是一种基于编码器 – 解码器结构的端到端语音合成模型。编码器将输入的文本转换为一系列的特征向量,解码器根据这些特征向量生成梅尔频谱,最后通过后处理网络将梅尔频谱转换为语音信号。

编码器的输出可以表示为:

解码器的输出可以表示为:

金融AI数学模型

逻辑回归数学模型

逻辑回归的数学模型可以表示为:

逻辑回归的损失函数通常使用对数损失函数:

举例说明

语音识别举例

假设我们有一个简单的语音识别任务,要识别“健康”和“发烧”两种状态,观测符号为“正常”、“寒冷”和“头晕”。根据HMM模型的参数,我们可以使用维特比算法计算最可能的状态序列。例如,当观测序列为(“正常”,“寒冷”,“头晕”)时,通过维特比算法计算得到最可能的状态序列为(“健康”,“健康”,“发烧”)。

语音合成举例

使用Tacotron 2和WaveGlow模型,输入文本“Hello, welcome to the financial world.”,模型可以生成相应的语音信号,并保存为音频文件“output.wav”。

金融AI举例

在信用风险评估中,我们可以使用逻辑回归模型根据客户的年龄、收入、信用历史等特征预测客户是否会违约。假设我们有一个包含100个客户信息的数据集,将其划分为训练集和测试集,使用训练集训练逻辑回归模型,然后使用测试集评估模型的准确率。例如,模型的准确率为0.8,表示模型在测试集上的预测准确率为80%。

5. 项目实战:代码实际案例和详细解释说明

5.1 开发环境搭建

语音技术开发环境

操作系统:推荐使用Ubuntu 18.04或更高版本,或者Windows 10。Python版本:推荐使用Python 3.7或更高版本。深度学习框架:安装PyTorch和TensorFlow,可根据自己的需求选择合适的版本。语音处理库:安装Librosa、SoundFile等库,用于语音信号处理。

金融AI开发环境

数据库:安装MySQL或PostgreSQL,用于存储金融数据。数据分析库:安装Pandas、NumPy、Scikit-learn等库,用于金融数据处理和分析。可视化库:安装Matplotlib、Seaborn等库,用于金融数据可视化。

5.2 源代码详细实现和代码解读

语音识别项目

import librosa

import torch

from transformers import Wav2Vec2ForCTC, Wav2Vec2Processor

# 加载预训练模型和处理器

processor = Wav2Vec2Processor.from_pretrained("facebook/wav2vec2-base-960h")

model = Wav2Vec2ForCTC.from_pretrained("facebook/wav2vec2-base-960h")

# 加载音频文件

audio, sr = librosa.load("audio.wav", sr=16000)

# 预处理音频数据

input_values = processor(audio, return_tensors="pt").input_values

# 进行语音识别

with torch.no_grad():

logits = model(input_values).logits

# 获取预测结果

predicted_ids = torch.argmax(logits, dim=-1)

transcription = processor.decode(predicted_ids[0])

print("Transcription:", transcription)

代码解读:

导入必要的库,包括Librosa用于音频处理,PyTorch用于深度学习,以及Wav2Vec2相关的预训练模型和处理器。加载预训练的Wav2Vec2模型和处理器。使用Librosa加载音频文件,并将其采样率调整为16000Hz。对音频数据进行预处理,将其转换为模型可以接受的输入格式。使用模型进行语音识别,得到预测的对数概率。通过argmax函数获取预测的标签ID,然后使用处理器将其解码为文本。

金融AI项目

import pandas as pd

from sklearn.model_selection import train_test_split

from sklearn.ensemble import RandomForestClassifier

from sklearn.metrics import accuracy_score

# 加载金融数据

data = pd.read_csv("financial_data.csv")

# 划分特征和标签

X = data.drop("label", axis=1)

y = data["label"]

# 划分训练集和测试集

X_train, X_test, y_train, y_test = train_test_split(X, y, test_size=0.2, random_state=42)

# 训练随机森林分类器

model = RandomForestClassifier()

model.fit(X_train, y_train)

# 预测

y_pred = model.predict(X_test)

# 评估模型

accuracy = accuracy_score(y_test, y_pred)

print("Accuracy:", accuracy)

代码解读:

导入必要的库,包括Pandas用于数据处理,Scikit-learn用于机器学习和模型评估。使用Pandas加载金融数据文件。划分特征和标签,将标签列从特征数据中分离出来。使用train_test_split函数将数据集划分为训练集和测试集。初始化随机森林分类器,并使用训练集进行训练。使用训练好的模型对测试集进行预测。使用accuracy_score函数评估模型的准确率。

5.3 代码解读与分析

语音识别代码分析

优点:使用预训练的Wav2Vec2模型可以快速实现语音识别任务,避免了模型训练的复杂过程。Librosa库提供了方便的音频处理功能,可以轻松加载和处理音频文件。缺点:预训练模型可能无法完全适应特定的语音识别任务,需要进行微调。音频文件的质量和格式可能会影响识别结果。

金融AI代码分析

优点:随机森林分类器是一种强大的机器学习算法,具有较好的泛化能力和抗过拟合能力。使用Scikit-learn库可以方便地进行数据处理、模型训练和评估。缺点:随机森林模型的训练时间可能较长,特别是在处理大规模数据集时。模型的解释性较差,难以理解模型的决策过程。

6. 实际应用场景

金融客服

语音技术可以实现智能客服系统,客户可以通过语音与客服系统进行交互,查询账户信息、办理业务等。智能客服系统可以使用语音识别技术将客户的语音指令转换为文本信息,然后使用自然语言处理技术理解客户的意图,最后使用语音合成技术将处理结果以语音的形式反馈给客户。这样可以提高客户服务的效率和质量,减少人工客服的工作量。

风险评估

在金融风险评估中,语音技术可以用于收集客户的语音信息,例如客户在电话中的语气、语速、用词等。这些语音信息可以作为额外的特征,与传统的金融数据一起用于风险评估模型的训练。例如,客户在电话中表现出紧张、焦虑的语气,可能暗示其信用风险较高。

投资决策

语音技术可以为投资者提供实时的市场信息和投资建议。投资者可以通过语音指令查询股票行情、基金净值等信息,系统可以使用语音合成技术将查询结果以语音的形式反馈给投资者。此外,系统还可以根据投资者的风险偏好和投资目标,使用金融AI算法生成个性化的投资建议,并通过语音进行播报。

身份验证

语音技术可以用于金融领域的身份验证。每个人的语音特征具有独特性,通过语音识别技术可以提取客户的语音特征,并与预先注册的语音模板进行比对,从而实现身份验证。这种身份验证方式具有方便、快捷、安全的特点,可以有效防止身份盗用和欺诈行为。

7. 工具和资源推荐

7.1 学习资源推荐

7.1.1 书籍推荐

《语音识别原理与应用》:详细介绍了语音识别的基本原理、算法和应用,是语音识别领域的经典教材。《深度学习》:由深度学习领域的三位顶尖专家撰写,系统地介绍了深度学习的理论和实践,包括神经网络、卷积神经网络、循环神经网络等。《金融科技:框架与实践》:介绍了金融科技的各个领域,包括金融AI、区块链、大数据等,对金融科技的发展趋势和应用场景进行了深入分析。

7.1.2 在线课程

Coursera上的“Speech Recognition for Machine Learning”:由斯坦福大学的教授授课,介绍了语音识别的基本原理和算法,以及如何使用Python实现语音识别系统。edX上的“Deep Learning Specialization”:由深度学习领域的知名专家授课,系统地介绍了深度学习的理论和实践,包括神经网络、卷积神经网络、循环神经网络等。网易云课堂上的“金融科技实战营”:结合实际案例,介绍了金融科技的各个领域,包括金融AI、区块链、大数据等,对金融科技的应用和实践进行了深入讲解。

7.1.3 技术博客和网站

Medium上的“Towards Data Science”:汇集了大量关于数据科学、机器学习、深度学习等领域的技术文章和案例分析。开源中国(OSChina):提供了丰富的开源项目和技术文章,涵盖了人工智能、金融科技等多个领域。中国金融科技网:专注于金融科技领域的新闻、政策、技术和应用,是了解金融科技发展动态的重要平台。

7.2 开发工具框架推荐

7.2.1 IDE和编辑器

PyCharm:是一款专门为Python开发设计的集成开发环境,具有代码编辑、调试、版本控制等功能,支持多种Python框架和库。Visual Studio Code:是一款轻量级的代码编辑器,具有丰富的插件和扩展功能,支持多种编程语言和开发框架。Jupyter Notebook:是一种交互式的编程环境,适合进行数据分析、机器学习和深度学习的实验和开发。

7.2.2 调试和性能分析工具

TensorBoard:是TensorFlow提供的可视化工具,可以用于可视化模型的训练过程、性能指标和网络结构。PyTorch Profiler:是PyTorch提供的性能分析工具,可以用于分析模型的运行时间、内存使用情况等。cProfile:是Python内置的性能分析工具,可以用于分析Python代码的运行时间和函数调用次数。

7.2.3 相关框架和库

PyTorch:是一个开源的深度学习框架,具有动态图计算、自动求导等特点,广泛应用于语音技术、计算机视觉、自然语言处理等领域。TensorFlow:是一个开源的深度学习框架,具有强大的分布式计算能力和丰富的工具和库,广泛应用于工业界和学术界。Scikit-learn:是一个开源的机器学习库,提供了丰富的机器学习算法和工具,包括分类、回归、聚类等。

7.3 相关论文著作推荐

7.3.1 经典论文

“Deep Speech: Scaling up end-to-end speech recognition”:介绍了Deep Speech模型,是端到端语音识别的经典论文。“Attention Is All You Need”:介绍了Transformer模型,是自然语言处理领域的重要突破,对语音技术也有重要的影响。“Random Forests”:介绍了随机森林算法,是机器学习领域的经典论文,在金融AI中也有广泛应用。

7.3.2 最新研究成果

每年的国际语音通信协会(ISCA)会议、神经信息处理系统大会(NeurIPS)、国际机器学习会议(ICML)等都会发表大量关于语音技术和金融AI的最新研究成果。顶级学术期刊如《IEEE Transactions on Audio, Speech, and Language Processing》、《Journal of Financial Economics》等也会发表相关的研究论文。

7.3.3 应用案例分析

《金融科技应用案例集》:收集了金融科技领域的各种应用案例,包括语音技术在金融客服、风险评估、投资决策等方面的应用案例。各大金融机构和科技公司的官方网站和博客也会发布一些关于语音技术在金融领域应用的案例分析和实践经验。

8. 总结:未来发展趋势与挑战

未来发展趋势

多模态融合

未来语音技术将与视觉、触觉等其他模态技术进行融合,实现更加自然和智能的人机交互。例如,在金融客服中,客户可以通过语音和手势同时与客服系统进行交互,提高交互的效率和体验。

个性化服务

随着金融行业的竞争加剧,个性化服务将成为未来的发展趋势。语音技术可以根据客户的语音特征、历史行为等信息,为客户提供个性化的金融产品和服务推荐。

智能化决策

金融AI将不断发展,语音技术将与金融AI深度融合,实现更加智能化的金融决策。例如,系统可以根据客户的语音指令和市场信息,自动进行投资决策和风险管理。

挑战

语音识别准确率

虽然语音识别技术已经取得了很大的进步,但在复杂环境下,如嘈杂的背景音、方言等,语音识别准确率仍然有待提高。

数据隐私和安全

金融领域涉及大量的敏感数据,语音数据也不例外。如何保护语音数据的隐私和安全,防止数据泄露和滥用,是语音技术在金融领域应用面临的重要挑战。

技术成本

语音技术的研发和应用需要大量的计算资源和数据支持,技术成本较高。如何降低技术成本,提高技术的性价比,是推动语音技术在金融领域广泛应用的关键。

9. 附录:常见问题与解答

语音识别准确率受哪些因素影响?

语音识别准确率受多种因素影响,包括语音质量、背景噪音、说话人的口音和语速、语音识别模型的训练数据和算法等。为了提高语音识别准确率,可以对语音信号进行预处理,如降噪、滤波等,选择合适的语音识别模型,并进行微调训练。

语音合成的自然度如何提高?

提高语音合成自然度可以从以下几个方面入手:选择合适的语音合成模型,如基于深度学习的端到端合成模型;使用大量的高质量语音数据进行训练;对合成语音进行后处理,如调整语调、语速、音色等。

金融AI模型如何评估和优化?

金融AI模型的评估可以使用多种指标,如准确率、召回率、F1值、AUC等。根据评估结果,可以对模型进行优化,如调整模型的超参数、增加训练数据、改进特征工程等。

语音技术在金融领域应用需要注意哪些法律和合规问题?

语音技术在金融领域应用需要注意数据隐私保护、信息安全、消费者权益保护等法律和合规问题。例如,在收集和使用客户的语音数据时,需要获得客户的明确授权,并采取必要的安全措施保护数据的隐私和安全。

10. 扩展阅读 & 参考资料

扩展阅读

《人工智能:现代方法》:全面介绍了人工智能的各个领域,包括搜索算法、机器学习、自然语言处理等,是人工智能领域的经典教材。《大数据时代:生活、工作与思维的大变革》:介绍了大数据的概念、技术和应用,探讨了大数据对社会和经济的影响。《区块链:技术驱动金融》:介绍了区块链的基本原理、技术和应用,探讨了区块链在金融领域的发展前景和挑战。

参考资料

国际语音通信协会(ISCA)官方网站:https://www.isca-speech.org/神经信息处理系统大会(NeurIPS)官方网站:https://neurips.cc/国际机器学习会议(ICML)官方网站:https://icml.cc/中国人民银行金融科技委员会发布的相关政策文件。各大金融机构和科技公司发布的关于语音技术在金融领域应用的研究报告和实践案例。

相关文章