舍弃CUDA编程!CMU等用代码将LLM编译成巨型内核,推理延迟降6.7倍

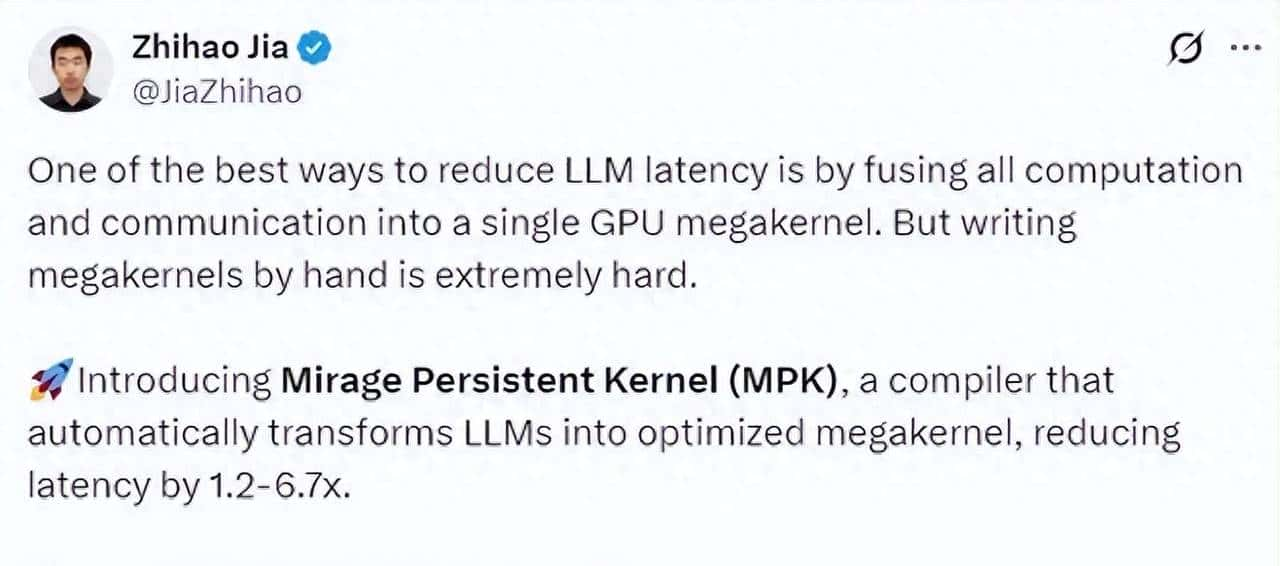

机器之心报道编辑:杜伟在 AI 领域,英伟达开发的 CUDA 是驱动大语言模型(LLM)训练和推理的核心计算引擎。不过,CUDA 驱动的 LLM 推理面临着手动优化成本高、端到端延迟高等不足,需要进一...

谷歌大模型登场!掀Agent风暴,放AI芯片大招,深夜突袭OpenAI

作者 | ZeR0 程茜编辑 | 漠影OpenAI的12天“圣诞大礼包”还没熄火,谷歌突然“插队”放出年末大招!智东西12月12日报道,今日,谷歌重磅发布其迄今最强劲的AI大模型Gemini 2.0...