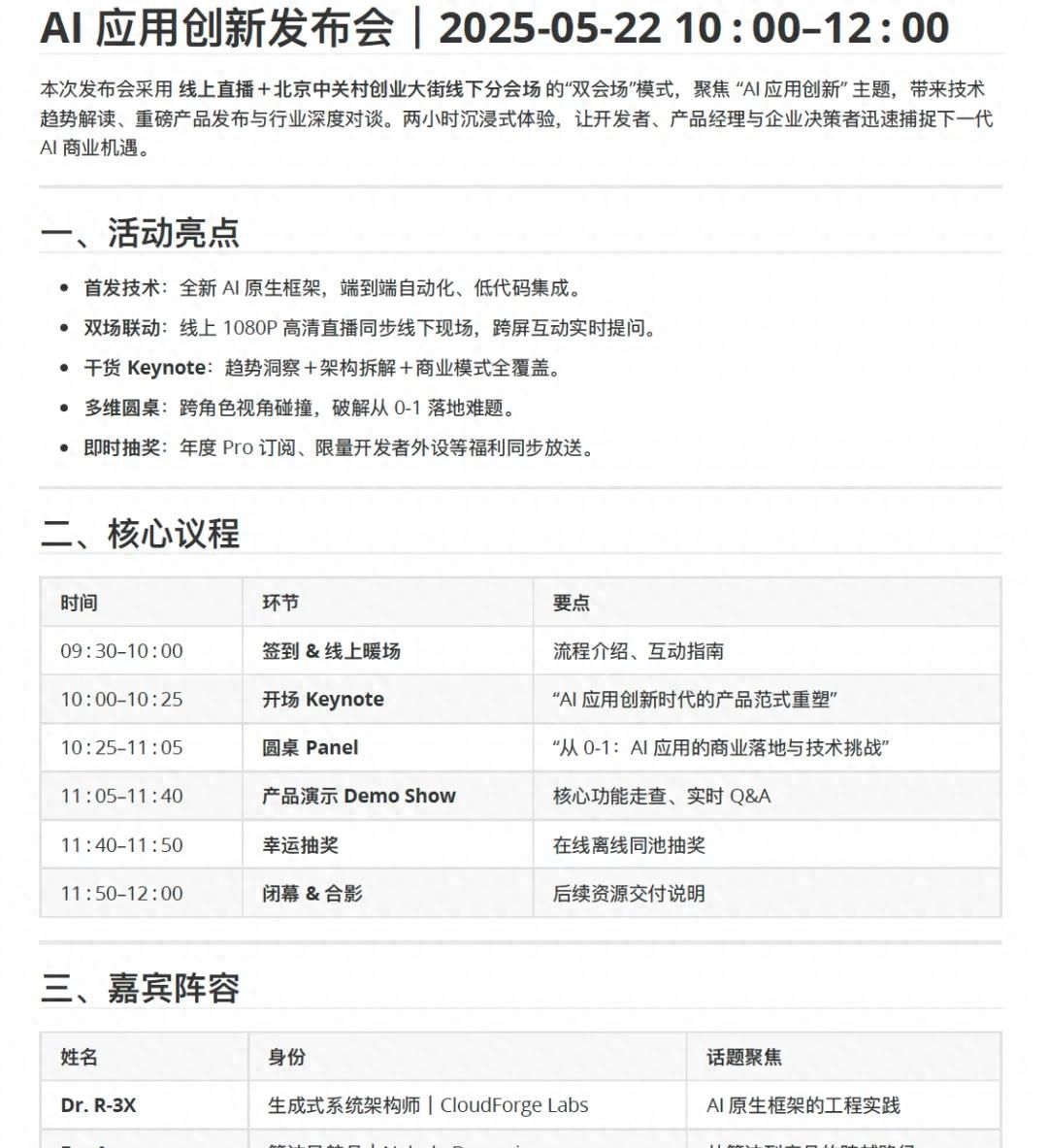

2025 年 10 月 20 日,DeepSeek 在 GitHub 开源了 DeepSeek-OCR 模型,并发布了《DeepSeek-OCR:Contexts Optical Compression》(《DeepSeek OCR:上下文光学压缩》)论文解释这一研究成果。

国内吃瓜群众,以为这只是又一个 OCR 模型,还说DeepSeek的创新能力下降了。

但实际上,它背后的方法与含义,可能会改变我们理解和使用大语言模型(LLM)的方式。

一、问题的根源:长文本的“算力噩梦”

目前几乎所有大模型都基于 Transformer 架构。

Transformer 的注意力机制随着序列长度呈二次方增长——也就是说,文本越长,算力和显存的消耗就呈指数爆炸。

给模型一个 10 万 token 的文档,它可能就会立刻陷入延迟、内存溢出,进入到成本上升的泥潭。

这不是模型的问题,而是架构早已标好的价格。

二、DeepSeek 的思路:让文本“变成图片”

DeepSeek 的突破在于,它没有去“拉长上下文窗口”,而是反其道而行:

与其扩大输入文本,不如把文本变成图像。

这听起来有点反直觉,但思路实则超级简洁:

一页文本,如果按文字输入,可能占 2000~5000 个 token;

但如果渲染成一张图片,再用视觉方式压缩,只需要 200~400 个“视觉 token”。

压缩率高达 10 倍。

DeepSeek-OCR 的理念是——

不把视觉当作附加特征,而是把它当作文本的“压缩层”。

这让模型能在极少 token 的条件下,完成原本需要庞大上下文窗口才能完成的任务。

三、这不只是 OCR,更是“思维方式”的重构

传统多模态模型中,视觉只是语言的补充:图像token往往比文本token低效得多。

但 DeepSeek 反转了这种关系:

它让图像成为语言的高效表达形式。

根据资料,其结果令人惊讶——

DeepSeek-OCR 仅用 100~200 个视觉 token 就能处理一整页内容,

OCR 准确率依然达到顶尖水平,

在速度和成本上远超 MinerU 2.0、GOT-OCR2.0 等传统强者。

更重大的是,它不仅能识别文本,还能:

- 将图表解析成 HTML 表格;

- 识别化学式并转化为 SMILES 字符串;

- 解析平面几何结构;

- 支持近 100 种语言;

- 同时保留字幕识别与物体定位等通用视觉能力。

凭借高效性,它在单张 A100 GPU 上每天能生成超 20 万页训练数据,

20 节点集群则可达 3300 万页——这几乎是一个数据工厂级别的生产力。

四、从“长上下文”到“视觉压缩”的范式转变

DeepSeek-OCR 带来的,不只是 OCR 技术的进步,而是一种全新的计算思维:

“不要再拉长上下文窗口,而在视觉上压缩它。”

国内另一家 Kimi 就是坚持拉长上下文窗口派系,以及Google Gemini。

这意味着:

|

对LLM开发者 |

具体意义 |

|

更低内存消耗 |

视觉token更紧凑 |

|

更快推理速度 |

token更少 → FLOP更少 |

|

自然的“遗忘机制” |

背景可下采样处理 |

|

更自然的多模态融合 |

模型已把文本视作图像 |

这种设计不再和“算力”硬碰硬,而是从“表明层”重新定义输入方式。

五、未来的想象:模型的“记忆”也许是视觉的

这项研究还有一个更深的启发:

也许未来的大模型不会把长期记忆存在 token 里,而是存在图片里。

这些图片可以被压缩、分层、逐渐褪色——

就像人类的记忆那样。

我们在寻找一本书的某一段时,总会记得那段文字大致在书的哪一页、哪一行。

这正是视觉记忆的工作跟踪原理。

DeepSeek-OCR 的原理,似乎在用工程方式复刻这种“人脑的存储逻辑”。

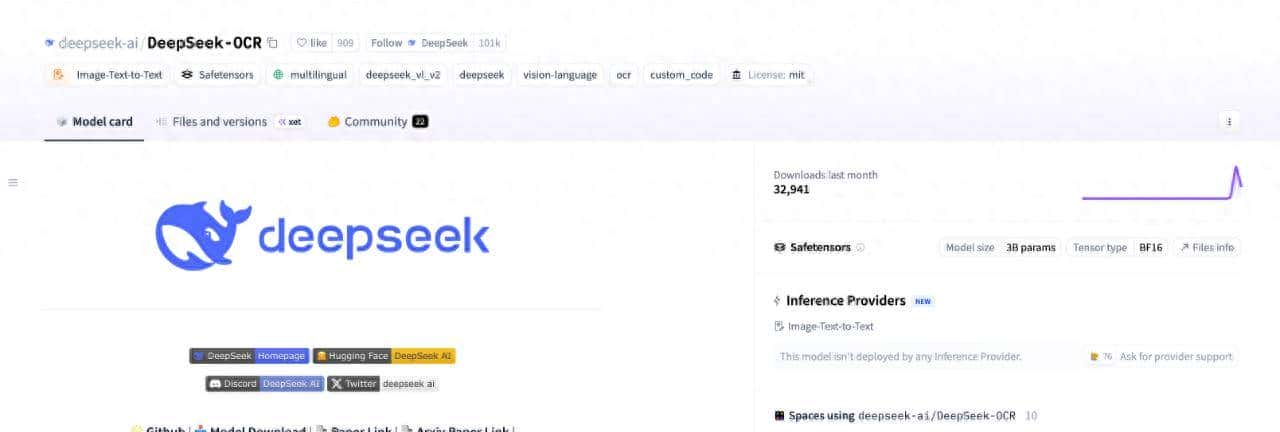

六、开放的力量

DeepSeek 最令人敬佩的一点是:

他们不仅提出了这种方法,还将系统完全开源。

这意味着,每一个研究者、开发者都可以复现、验证,

甚至在此基础上构建新的“视觉上下文”范式。

据传谷歌的 Gemini 可能也在探索类似的机制。这或许就可以解释了它们为什么在长上下文与 OCR 任务中表现的比较好。但对于谷歌而言,这是商业机密。

但 DeepSeek 是开放的!

七、结语:也许不需要更长的上下文,而是更小的视觉

DeepSeek-OCR 给出的不是一个终极方案,而是一种启发:

“或许上下文问题的答案,不是扩大窗口,而是压缩视野。”

当模型开始像人类一样,以视觉方式去“看”信息、记忆内容、提取要点时,

我们或许真的在接近下一代智能的边界。

一句话总结一下:

DeepSeek-OCR 让我们看到,AI 的边界不在芯片,而在想象力。

正如 DeepSeek 一贯的姿态:当别人比拼算力,它在思考另一种可能。

参考资料

- deepseek-ai/DeepSeek-OCR[1]

- DeepSeek OCR is here[2]

- The Innovations in DeepSeek OCR[3]

引用链接

[1] deepseek-ai/DeepSeek-OCR: https://huggingface.co/deepseek-ai/DeepSeek-OCR

[2] DeepSeek OCR is here: https://medium.com/data-science-in-your-pocket/deepseek-ocr-is-here-37096b562bb0

[3] The Innovations in DeepSeek OCR: https://www.reddit.com/r/LocalLLaMA/comments/1obn0q7/the_innovations_in_deepseek_ocr/

相关文章